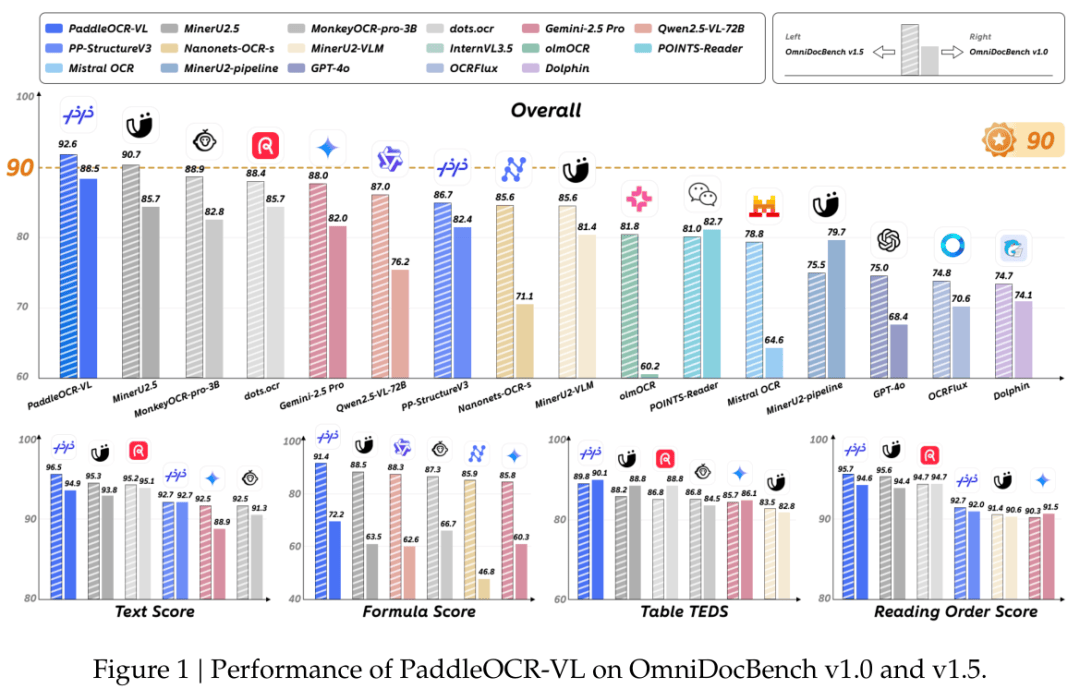

百度用一個僅0.9B參數的模型,在權威的文檔解析評測榜單OmniDocBench V1.5上,拿下了92.6分的綜合成績,位列全球第一。

這個叫作PaddleOCR-VL的模型,發布不到一天,就在技術圈的開源社區Hugging Face上沖到了全球熱度榜首。現在仍然霸榜。

它不只是總分高,在文本識別,公式識別,表格理解和閱讀順序這四個文檔解析最核心的能力維度上,全都做到了業界最佳水平,是目前唯一一個在這四項上全部登頂的模型。

它還能處理109種語言,從常見的中文,英文,日文,韓文,到結構復雜的俄語(西里爾字母),阿拉伯語,印地語(天城文)和泰語,基本覆蓋了全球主要語言體系。

這個事兒有意思的地方在于,當下大家普遍的認知是模型參數量越大,能力越強。百度這個0.9B參數的模型能取得這樣的成績,怎么做到的?

庖丁解牛,先把任務拆開

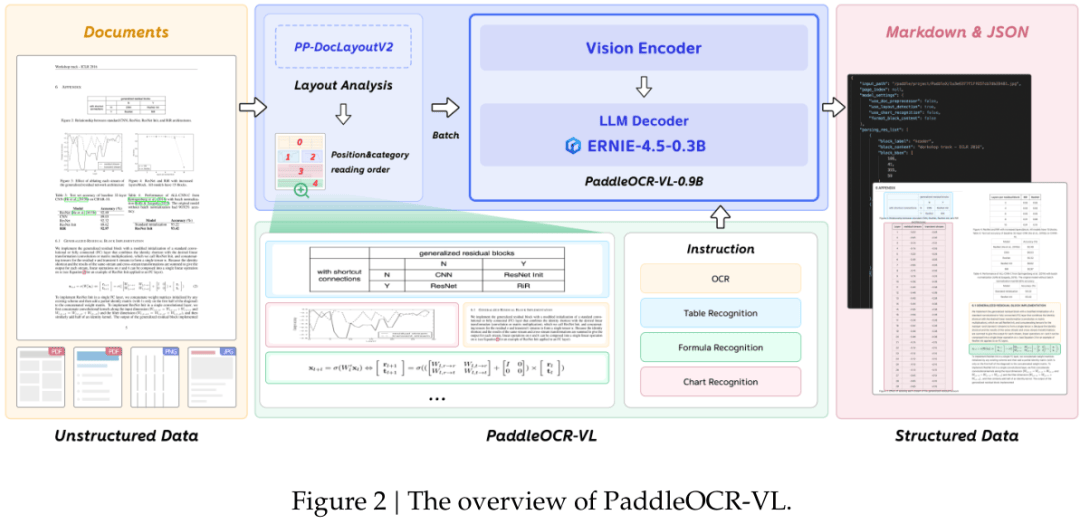

模型能做到又小又強,關鍵在于它的設計思路。PaddleOCR-VL沒有選擇做一個大而全的端到端模型,把一張文檔圖片直接扔進去,讓模型自己搞定所有事。

那種方法聽起來很酷,但在實際應用中常常會遇到麻煩,比如模型容易產生幻覺,搞錯文本的閱讀順序,或者在處理復雜長文檔時計算成本高得嚇人,難以落地。

PaddleOCR-VL用的是一個兩階段架構。